Nächste Seite: 14 Eigenwerte und Eigenvektoren Aufwärts: Mathematik 1 für Informatik Vorherige Seite: 12 Determinante Inhalt Index

Bislang haben wir nur die Addition und Skalarmultiplikation verwendet. In der Ebene und im Raum können wir aber auch Abstände und Winkel messen. Diese Operationen sehen wir uns nun näher an.

13.1 Definition.

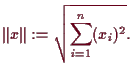

Die Länge eines Vektors

![]() ist nach dem

pythagoräischen Lehrsatz und Induktion

ist nach dem

pythagoräischen Lehrsatz und Induktion

![\includegraphics[scale=0.7]{pic-1019}](img3410.png)

Multipliziert man

![]() mit

mit

![]() so gilt dies für das Ergebnis

so gilt dies für das Ergebnis

![]() noch immer und zusätzlich ist dieser Ausdruck

nun symmetrisch in

noch immer und zusätzlich ist dieser Ausdruck

nun symmetrisch in

![]() und

und

![]() und damit auch linear in der zweiten Variable

und damit auch linear in der zweiten Variable

![]() .

Es muß also

.

Es muß also

![]() eine symmetrische bilineare Abbildung sein,

die

eine symmetrische bilineare Abbildung sein,

die

![]() liefert und auf orthogonalen

liefert und auf orthogonalen

![]() und

und

![]() verschwindet.

verschwindet.

Auf einen Vektorraum nennt man eine symmetrische bilineare Abbildung

![]() die positiv definit ist, d.h.

die positiv definit ist, d.h.

![]() für alle

für alle

![]() erfüllt, ein skalares Produkt (im Unterschied zur

skalar-Multiplikation

erfüllt, ein skalares Produkt (im Unterschied zur

skalar-Multiplikation

![]() ).

).

13.2 Bemerkung.

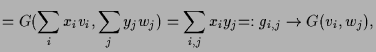

Jede bilineare Abbildung

![]() ist wie folgt duch eine Matrix

ist wie folgt duch eine Matrix

![]() (die Gram'sche Matrix)

bezüglich Basen

(die Gram'sche Matrix)

bezüglich Basen

![]() von

von

![]() und

und

![]() von W

gegeben

von W

gegeben

|

|

13.3 Bemerkung.

Die Gram'sche Matrix

![]() einer bilinearen Abbildung

einer bilinearen Abbildung

![]() ist genau dann symmetrisch, d.h.

stimmt mir der Transponierten überein, wenn

ist genau dann symmetrisch, d.h.

stimmt mir der Transponierten überein, wenn

![]() symmetrisch ist, d.h.

symmetrisch ist, d.h.

![]() für alle

für alle

![]() gilt.

gilt.

Man kann zeigen, daß folgendes gilt:

13.4 Proposition.

Eine symmetrische Bilinearform

![]() ist genau dann positiv definit, wenn

für alle

ist genau dann positiv definit, wenn

für alle

![]() die Hauptminore

die Hauptminore

![]() positiv ist.

positiv ist.

13.5 Definition.

Ist

![]() ein skalares Produkt auf

ein skalares Produkt auf

![]() , so können

wir die Länge eines Vektors als

, so können

wir die Länge eines Vektors als

13.6 Ungleichung von Cauchy-Schwarz.

Für jedes skalare Produkt

![]() gilt die

Ungleichung

gilt die

Ungleichung

![]() für alle

für alle

![]() .

Gleichheit gilt genau dann, wenn

.

Gleichheit gilt genau dann, wenn

![]() linear abhängig ist.

linear abhängig ist.

Beweis. Es ist

13.7 Lemma.

Es sei

![]() ein skalares Produkt und

ein skalares Produkt und

![]() .

Dann gilt,

die Norm

.

Dann gilt,

die Norm

![]() erfüllt die positive Homogenität

erfüllt die positive Homogenität

![]() , die Dreiecksungleichung

, die Dreiecksungleichung

![]() sowie die Parallelogramformel

sowie die Parallelogramformel

![]() .

.

Beweis.

13.8 Definition.

Man sagt zwei Vektoren

![]() und

und

![]() stehen rechtwinkelig (oder

orthogonal) aufeinander und man schreibt

stehen rechtwinkelig (oder

orthogonal) aufeinander und man schreibt

![]() genau dann, wenn

genau dann, wenn

![]() ist.

ist.

Für

![]() bezeichnet

bezeichnet

![]() das orthogonale Komplement von

das orthogonale Komplement von

![]() . Falls

. Falls

![]() ein Teilraum ist, dann ist

offensichtlich

ein Teilraum ist, dann ist

offensichtlich

![]() ein Komplementärraum zum

ein Komplementärraum zum

![]() im Sinne von

(8.19).

im Sinne von

(8.19).

Eine Familie

![]() heißt orthogonal-System, falls die Vektoren paarweise

orthogonal stehen, d.h.

heißt orthogonal-System, falls die Vektoren paarweise

orthogonal stehen, d.h.

![]() für alle

für alle

![]() .

.

Eine Familie

![]() heißt orthonormal-System, falls diese Vektoren paarweise

orthogonal stehen und Länge 1 besitzen, d.h.

heißt orthonormal-System, falls diese Vektoren paarweise

orthogonal stehen und Länge 1 besitzen, d.h.

![]() für alle

für alle

![]() .

.

Eine Basis, die ein orthonormal-System ist, heißt orthonormal-Basis.

Der folgende Satz ermöglicht uns aus eine beliebigen Basis eine orthonormal-Basis zu gewinnen.

13.9 Gram-Schmidt'sches Orthonormalisierungsverfahren.

Es seien

![]() linear unabhängig.

Wir konstruieren rekursiv ein orthonormal-System

linear unabhängig.

Wir konstruieren rekursiv ein orthonormal-System

![]() , welches den

selben Teilraum erzeugt.

Es sei

, welches den

selben Teilraum erzeugt.

Es sei

![]() (

(

![]() , da linear unabhängig).

Es sei

, da linear unabhängig).

Es sei

![]() und

und

![]() .

Offensichtlich erzeugt

.

Offensichtlich erzeugt

![]() den selben Teilraum wie

den selben Teilraum wie

![]() .

Weiters ist

.

Weiters ist

![]() , denn sonst wäre

, denn sonst wäre

![]() eine Linearkombination

von

eine Linearkombination

von

![]() und damit auch von

und damit auch von

![]() , also

, also

![]() linear abhängig.

linear abhängig.

13.10 Definition.

Eine (lineare) Abbildung

![]() heißt Isometrie (oder

Längenbewahrend), wenn

heißt Isometrie (oder

Längenbewahrend), wenn

![]() für alle

für alle

![]() gilt.

Wegen der Polarisierungsgleichung

gilt.

Wegen der Polarisierungsgleichung

![]() ist dann auch

ist dann auch

![]() und die Abbildung

somit auch Winkelbewahrend und weiters ist

somit

und die Abbildung

somit auch Winkelbewahrend und weiters ist

somit

![]() , d.h.

, d.h.

![]() ist regulär mit inverser

ist regulär mit inverser

![]() .

Insbesonders ist

.

Insbesonders ist

![]() , d.h.

, d.h.

![]() , also bis auf ein mögliches Vorzeichen

, also bis auf ein mögliches Vorzeichen

![]() auch

Volumsbewahrend.

auch

Volumsbewahrend.

Eine reelle Matrix

![]() heißt symmetrisch, wenn

heißt symmetrisch, wenn

![]() ist, d.h.

ist, d.h.

![]() für alle

für alle

![]() gilt.

gilt.

13.11 Proposition.

Eine lineare Abbildung

![]() ist genau dann eine Isometrie, wenn sie orthogonal ist,

d.h. die Spalten einer Matrixdarstellung

bzgl. orthonormal-Basen eine orthonormal-Basis bilden.

ist genau dann eine Isometrie, wenn sie orthogonal ist,

d.h. die Spalten einer Matrixdarstellung

bzgl. orthonormal-Basen eine orthonormal-Basis bilden.

Beweis. Es ist

13.12 Definition.

Ein orthogonale Abbildung mit

![]() heißt uneigentlich orthogonal.

Insbesonders gilt dies für die Spiegelung an der normalen Hyperebene

heißt uneigentlich orthogonal.

Insbesonders gilt dies für die Spiegelung an der normalen Hyperebene

![]() zu einem

Einheitsvektor

zu einem

Einheitsvektor

![]() gegeben

durch

gegeben

durch

![]() .

.

![\includegraphics[scale=0.7]{pic-1020}](img3490.png)

13.13 Bemerkung.

Man kann zeigen, daß jede orthogonale Matrix eine Zusammensetzung von Spiegelungen ist.

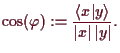

13.14 Definition.

Falls eine orthogonale Matrix positive Determinante hat, so heißt sie eigentlich

orthogonal. Insbesonders gilt dies für die Zusammensetzung

zweier Spiegelungen, d.h. eine Drehung um

![]() mit Winkel

mit Winkel

![]() .

.

13.15 Proposition.

Es sei

![]() . Dann ist das orthogonale Komplement

des Bildes

. Dann ist das orthogonale Komplement

des Bildes

![]() von

von

![]() gerade der Kern

gerade der Kern

![]() der

transponierten Abbildung

der

transponierten Abbildung

![]() , d.h.

, d.h.

Beweis. Für

13.16 Volumen des Parallelipipeds.

Die Fläche des von zwei Vektoren

![]() und

und

![]() aufgespannten Parallelogramms

ist

aufgespannten Parallelogramms

ist

![]() ,

wobei die Höhe

,

wobei die Höhe

![]() ist.

Also

ist.

Also

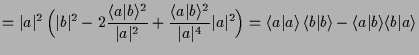

|

||

|

13.17 Vektorprodukt.

Für Vektoren

![]() ist

das Kreuzprodukt

ist

das Kreuzprodukt

![]() .

Die Abbildung

.

Die Abbildung

![]() ist bilinear,

ist bilinear,

![]() ,

,

![]() und

und

![]() .

.

14.5 Definition. Metrik komplexer Vektorräume.

Für

![]() definiert man die Länge eines Vektors

definiert man die Länge eines Vektors

![]() als Länge des zugehörigen reellen Vektors

als Länge des zugehörigen reellen Vektors

![]() , wobei

, wobei

![]() die Zerlegung der komplexen Koordinaten in Real- und Imaginärteil ist,

d.h.

die Zerlegung der komplexen Koordinaten in Real- und Imaginärteil ist,

d.h.

![]() .

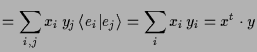

Wie im reellen Fall suchen wir nun

ebenfalls eine

Abbildung

.

Wie im reellen Fall suchen wir nun

ebenfalls eine

Abbildung

![]() , welche

, welche

![]() erfüllt.

Dazu konjugiert man den zweiten Vektor in der Formel

erfüllt.

Dazu konjugiert man den zweiten Vektor in der Formel

![]() .

Es ist

.

Es ist

![]() und somit

und somit

![]() -linear

in der ersten Variable und konjugiert linear (d.h.

-linear

in der ersten Variable und konjugiert linear (d.h.

![]() ) in der zweiten.

) in der zweiten.

Andreas Kriegl 2002-02-01